上一个教程: 在 G-API 上移植各向异性图像分割

引言

在本教程中,您将学习

- 一个人脸美化算法的示例基础;

- 如何使用 G-API 在流水线中推断不同的网络;

- 如何在视频流上运行 G-API 流水线。

先决条件

此示例需要

- 装有 GNU/Linux 或 Microsoft Windows 的 PC(支持 Apple macOS 但未经测试);

- 使用 Intel® Distribution of OpenVINO™ Toolkit 构建的 OpenCV 4.2 或更高版本(使用 Intel® TBB 构建更佳);

- OpenVINO™ Toolkit Open Model Zoo 中的以下拓扑:

face-detection-adas-0001;facial-landmarks-35-adas-0002.

人脸美化算法

我们将结合现代深度学习技术和传统计算机视觉来实现一个简单的人脸美化算法。该算法的基本思想是使面部皮肤更光滑,同时保留眼睛或嘴巴对比度等面部特征。该算法使用 DNN 推理识别人脸的各个部分,对找到的部分应用不同的滤镜,然后使用基本的图像算术将其组合成最终结果。

该算法简述如下:

- 输入图像 \(I\) 经过非锐化掩膜和双边滤镜(分别为 \(U\) 和 \(L\) )处理;

- 输入图像 \(I\) 经过基于 SSD 的人脸检测器处理;

- SSD 结果(一个 \([1 \times 1 \times 200 \times 7]\) blob)被解析并转换为人脸数组;

- 每张人脸都经过关键点检测器处理;

- 根据每张人脸的关键点,生成三个图像掩膜:

- 背景掩膜 \(b\) – 指示原始图像中哪些区域保持不变;

- 面部特征掩膜 \(p\) – 识别要保留(锐化)的区域。

- 面部皮肤掩膜 \(s\) – 识别要模糊的区域;

- 最终结果 \(O\) 是上述特征的组合,计算公式为 \(O = b*I + p*U + s*L\)。

基于有限的特征集(每张人脸仅 35 个,包括其所有部分)生成面部元素掩膜并非易事,将在以下部分进行描述。

构建 G-API 流水线

声明深度学习拓扑

此示例使用两个 DNN 检测器。每个网络都接受一个输入并产生一个输出。在 G-API 中,网络通过宏 G_API_NET() 定义:

欲了解更多信息,请参阅“人脸分析流水线”教程中描述的声明深度学习拓扑。

描述处理图

以下代码为上述算法生成一个图:

{

GArrayROI garRects = custom::GFacePostProc::on(faceOut, gimgIn, config::kConfThresh);

std::tie(garElems, garJaws) = custom::GLandmPostProc::on(landmOut, garRects);

std::tie(garElsConts, garFaceConts) = custom::GGetContours::on(garElems, garJaws);

cv::GMat mskSharp = custom::GFillPolyGContours::on(gimgIn, garElsConts);

config::kGSigma);

cv::GMat mskBlur = custom::GFillPolyGContours::on(gimgIn, garFaceConts);

config::kGSigma);

cv::GMat mskFacesGaussed = mskBlurFinal + mskSharpG;

cv::GMat gimgBilat = custom::GBilatFilter::on(gimgIn, config::kBSize,

config::kBSigmaCol, config::kBSigmaSp);

cv::GMat gimgSharp = custom::unsharpMask(gimgIn, config::kUnshSigma,

config::kUnshStrength);

cv::GMat gimgBilatMasked = custom::mask3C(gimgBilat, mskBlurFinal);

cv::GMat gimgSharpMasked = custom::mask3C(gimgSharp, mskSharpG);

cv::GMat gimgInMasked = custom::mask3C(gimgIn, mskNoFaces);

cv::GMat gimgBeautif = gimgBilatMasked + gimgSharpMasked + gimgInMasked;

garFaceConts,

garElsConts,

garRects));

});

结果图是 G-API 标准操作、用户定义操作(命名空间 custom::)和 DNN 推理的混合。通用函数 cv::gapi::infer<>() 允许在流水线内触发推理;要推理的网络被指定为模板参数。示例代码使用了两个版本的 cv::gapi::infer<>():

- 帧导向版本用于检测输入帧中的人脸。

- ROI 列表导向版本用于对人脸列表运行关键点推理——此版本为每张人脸生成一个关键点数组。

更多内容请参见“人脸分析流水线”(构建 GComputation 部分)。

G-API 中的 USM 锐化(非锐化掩膜)

图像 \(I\) 的非锐化掩膜 \(U\) 定义为:

\[U = I - s * L(M(I)),\]

其中 \(M()\) 是中值滤镜,\(L()\) 是拉普拉斯算子,\(s\) 是强度系数。虽然 G-API 没有直接提供此函数,但它可以自然地通过现有 G-API 操作来表达:

const int sigma,

const float strength)

{

return (src - (laplacian * strength));

}

请注意,上面的代码片段是使用 G-API 类型定义的常规 C++ 函数。用户可以编写此类函数来简化图的构建;当调用时,此函数只会将其相关节点放入使用的流水线中。

自定义操作

人脸美化图广泛使用了自定义操作。本章重点介绍最有趣的内核,有关在 G-API 中定义操作和实现内核的通用信息,请参阅 G-API 内核 API。

人脸检测器后处理

人脸检测器输出通过以下内核转换为人脸数组:

using VectorROI = std::vector<cv::Rect>;

{

static void run(

const cv::Mat &inDetectResult,

const float faceConfThreshold,

VectorROI &outFaces)

{

const int kObjectSize = 7;

const int imgCols = inFrame.

size().width;

const int imgRows = inFrame.

size().height;

outFaces.clear();

const int numOfDetections = inDetectResult.

size[2];

const float *data = inDetectResult.

ptr<

float>();

for (int i = 0; i < numOfDetections; i++)

{

const float faceId = data[i * kObjectSize + 0];

if (faceId < 0.f)

{

break;

}

const float faceConfidence = data[i * kObjectSize + 2];

if (faceConfidence > faceConfThreshold)

{

const float left = data[i * kObjectSize + 3];

const float top = data[i * kObjectSize + 4];

const float right = data[i * kObjectSize + 5];

const float bottom = data[i * kObjectSize + 6];

toIntRounded(top * imgRows));

toIntRounded(bottom * imgRows));

outFaces.push_back(

cv::Rect(tl, br) & borders);

}

}

}

};

人脸关键点后处理

该算法使用 OpenVINO™ Open Model Zoo 中的通用人脸关键点检测器(详情)推断人脸元素(如眼睛、嘴巴和头部轮廓本身)的位置。然而,直接检测到的关键点不足以生成掩膜——此操作需要用闭合轮廓表示的人脸感兴趣区域,因此需要应用一些插值来获取它们。此关键点处理和插值由以下内核执行:

{

static void run(const std::vector<Landmarks> &vctPtsFaceElems,

const std::vector<Contour> &vctCntJaw,

std::vector<Contour> &vctElemsContours,

std::vector<Contour> &vctFaceContours)

{

size_t numFaces = vctCntJaw.size();

CV_Assert(numFaces == vctPtsFaceElems.size());

vctElemsContours.reserve(numFaces * 4);

vctFaceContours.reserve(numFaces);

Contour cntFace, cntLeftEye, cntRightEye, cntNose, cntMouth;

cntNose.reserve(4);

for (size_t i = 0ul; i < numFaces; i++)

{

cntLeftEye = getEyeEllipse(vctPtsFaceElems[i][1], vctPtsFaceElems[i][0]);

cntLeftEye.insert(cntLeftEye.end(), {vctPtsFaceElems[i][12], vctPtsFaceElems[i][13],

vctPtsFaceElems[i][14]});

cntRightEye = getEyeEllipse(vctPtsFaceElems[i][2], vctPtsFaceElems[i][3]);

cntRightEye.insert(cntRightEye.end(), {vctPtsFaceElems[i][15], vctPtsFaceElems[i][16],

vctPtsFaceElems[i][17]});

cntNose.clear();

cntNose.insert(cntNose.end(), {vctPtsFaceElems[i][4], vctPtsFaceElems[i][7],

vctPtsFaceElems[i][5], vctPtsFaceElems[i][6]});

cntMouth = getPatchedEllipse(vctPtsFaceElems[i][8], vctPtsFaceElems[i][9],

vctPtsFaceElems[i][10], vctPtsFaceElems[i][11]);

vctElemsContours.insert(vctElemsContours.end(), {cntLeftEye, cntRightEye, cntNose, cntMouth});

cntFace = getForeheadEllipse(vctCntJaw[i][0], vctCntJaw[i][16], vctCntJaw[i][8]);

std::copy(vctCntJaw[i].crbegin(), vctCntJaw[i].crend(), std::back_inserter(cntFace));

vctFaceContours.push_back(cntFace);

}

}

};

该内核接受两个去归一化的关键点坐标数组,并返回一个元素闭合轮廓数组和一个面部闭合轮廓数组;换句话说,输出分别是用于锐化的图像区域轮廓数组和用于平滑的图像区域轮廓数组。

在此及下文中,Contour 是一个点向量。

获取眼睛轮廓

眼睛轮廓通过以下函数估计:

inline int custom::getLineInclinationAngleDegrees(

const cv::Point &ptLeft,

const cv::Point &ptRight)

{

if (residual.

y == 0 && residual.

x == 0)

return 0;

else

return toIntRounded(

atan2(toDouble(residual.

y), toDouble(residual.

x)) * 180.0 /

CV_PI);

}

{

Contour cntEyeBottom;

const cv::Point ptEyeCenter((ptRight + ptLeft) / 2);

const int angle = getLineInclinationAngleDegrees(ptLeft, ptRight);

const int axisX = toIntRounded(

cv::norm(ptRight - ptLeft) / 2.0);

const int axisY = axisX / 3;

static constexpr int kAngEyeStart = 0;

static constexpr int kAngEyeEnd = 180;

cntEyeBottom);

return cntEyeBottom;

}

简而言之,此函数通过基于左右眼角两点的半椭圆来恢复眼睛的下侧。实际上,cv::ellipse2Poly() 用于近似眼睛区域,该函数仅基于两点定义椭圆参数:

- 由两个眼睛点计算的椭圆中心和 \(X\) 半轴;

- 根据平均眼睛宽度是其长度的 \(1/3\) 这一假设计算的 \(Y\) 半轴;

- 起始和结束角度分别为 0 和 180(请参阅

cv::ellipse() 文档);

- 角度增量:在轮廓中生成多少个点;

- 轴的倾斜角。

在 custom::getLineInclinationAngleDegrees() 函数中使用 atan2() 而不仅仅是 atan() 是至关重要的,因为它允许根据 x 和 y 的符号返回负值,这样即使在人脸倒置的情况下(当然,如果我们以正确的顺序放置点),我们也能获得正确的角度。

获取额头轮廓

该函数近似额头轮廓:

inline Contour custom::getForeheadEllipse(

const cv::Point &ptJawLeft,

{

Contour cntForehead;

const cv::Point ptFaceCenter((ptJawLeft + ptJawRight) / 2);

const int angFace = getLineInclinationAngleDegrees(ptJawLeft, ptJawRight);

const double jawWidth =

cv::norm(ptJawLeft - ptJawRight);

const int axisX = toIntRounded(jawWidth / 2.0);

const double jawHeight =

cv::norm(ptFaceCenter - ptJawLower);

const int axisY = toIntRounded(jawHeight * 2 / 3.0);

static constexpr int kAngForeheadStart = 180;

static constexpr int kAngForeheadEnd = 360;

config::kAngDelta, cntForehead);

return cntForehead;

}

由于我们检测到的关键点中只有下颌点,因此我们必须根据下颌的三个点(最左边、最右边和最低点)来获取一个半椭圆。下颌宽度被认为等于额头宽度,后者是使用左右点计算的。至于 \(Y\) 轴,我们没有直接获取它的点,而是假设额头高度大约是下颌高度的 \(2/3\),这可以通过面部中心(左右点之间的中间点)和最低下颌点计算出来。

绘制掩膜

当我们拥有所需的所有轮廓时,我们就能够绘制掩膜了。

cv::GMat mskSharp = custom::GFillPolyGContours::on(gimgIn, garElsConts);

config::kGSigma);

cv::GMat mskBlur = custom::GFillPolyGContours::on(gimgIn, garFaceConts);

config::kGSigma);

cv::GMat mskFacesGaussed = mskBlurFinal + mskSharpG;

获取掩膜的步骤是:

- “锐化”掩膜计算

- 填充需要锐化的轮廓;

- 模糊该区域以获得“锐化”掩膜(

mskSharpG);

- “双边”掩膜计算

- 完全填充所有人脸轮廓;

- 模糊该区域;

- 减去与“锐化”掩膜相交的区域——并获得“双边”掩膜(

mskBlurFinal);

- 背景掩膜计算

配置并运行流水线

一旦图完全表达,我们就可以最终编译它并在真实数据上运行。G-API 图编译是 G-API 框架实际理解要使用哪些内核和网络的阶段。此配置通过 G-API 编译参数进行。

DNN 参数

此示例使用 OpenVINO™ Toolkit 推理引擎后端进行 DL 推理,其配置方式如下:

{

faceXmlPath,

faceBinPath,

faceDevice

};

{

landmXmlPath,

landmBinPath,

landmDevice

};

每个 cv::gapi::ie::Params<> 对象都与其模板参数中指定的网络相关。我们应该将本教程开始时在 G_API_NET() 中定义的网络类型传递给它。

网络参数随后被封装在 cv::gapi::NetworkPackage 中:

更多详情请参见“人脸分析流水线”(配置流水线 部分)。

内核包

在本例中,我们使用了许多自定义内核,此外,我们还使用了 Fluid 后端来优化 G-API 标准内核的内存(如果适用)。生成的内核包形式如下:

custom::GCPULaplacian,

custom::GCPUFillPolyGContours,

custom::GCPUPolyLines,

custom::GCPURectangle,

custom::GCPUFacePostProc,

custom::GCPULandmPostProc,

custom::GCPUGetContours>();

customKernels);

编译流式流水线

当以“流式”模式编译时,G-API 会优化视频流的执行。

更多内容请参见“人脸分析流水线”(配置流水线 部分)。

运行流式流水线

为了运行 G-API 流式流水线,我们所需要做的就是指定输入视频源,调用 cv::GStreamingCompiled::start(),然后获取流水线处理结果:

if (parser.has("input"))

{

}

auto out_vector =

cv::gout(imgBeautif, imgShow, vctFaceConts,

vctElsConts, vctRects);

avg.start();

{

if (!stream.

try_pull(std::move(out_vector)))

{

else continue;

}

frames++;

if (flgLandmarks == true)

{

config::kClrYellow);

config::kClrYellow);

}

if (flgBoxes == true)

for (auto rect : vctRects)

cv::imshow(config::kWinFaceBeautification, imgBeautif);

}

一旦结果准备就绪并可以从流水线中拉取,我们就会将其显示在屏幕上并处理 GUI 事件。

有关更多详细信息,请参阅“人脸分析流水线”教程中的 运行流水线 部分。

结论

本教程有两个目标:展示 OpenCV 4.2 中引入的 G-API 新功能的使用,并提供对人脸美化算法示例的基本理解。

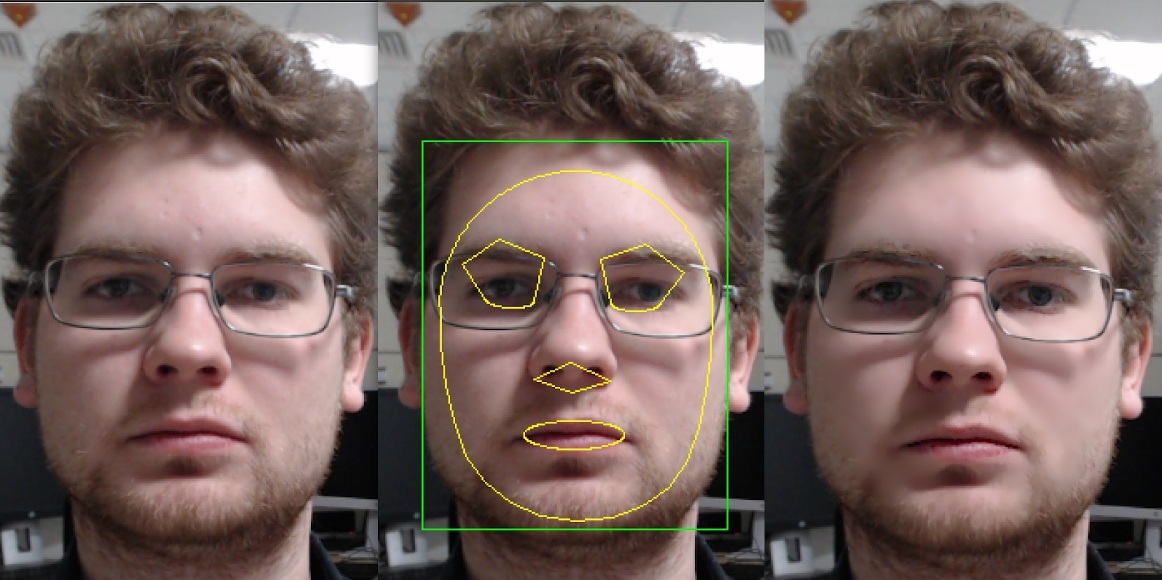

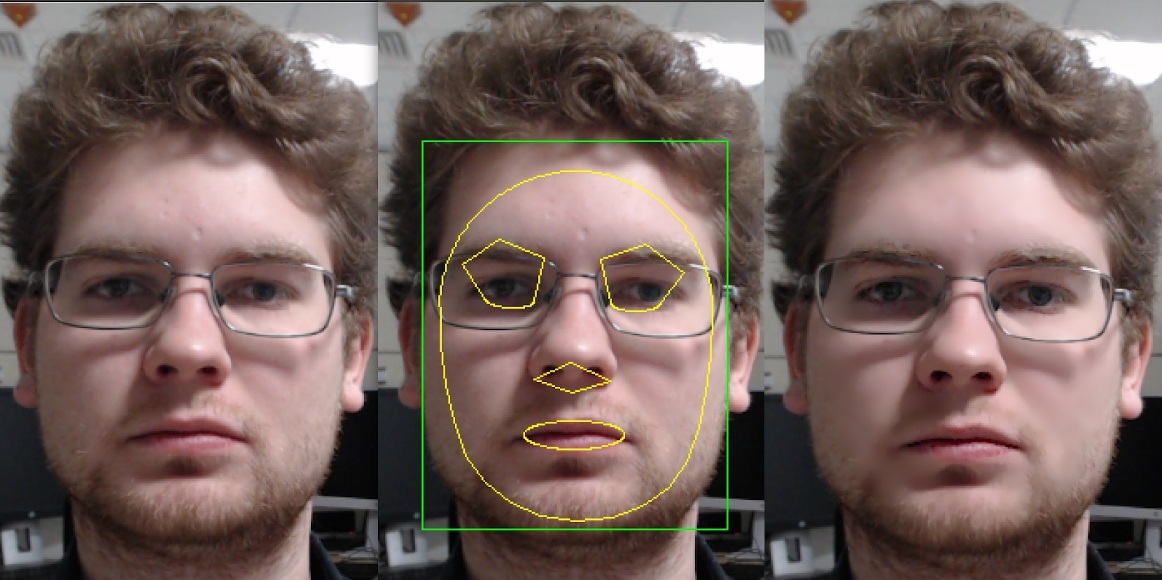

算法应用结果:

人脸美化示例

在测试机器(Intel® Core™ i7-8700)上,G-API 优化的视频流水线比其串行(非流水线)版本性能高出 2.7 倍——这意味着对于这样一个复杂的图,适当的流水线化可以带来近 3 倍的性能提升。